Đối với những người làm SEO như chúng ta, có rất nhiều chi tiết cần phải xem xét, nó choán hết cả ngày làm việc của chúng ta, có thể kể đến như cấu trúc server, chuyển hướng 301, trang lỗi 404, thẻ tiêu đề, và nhiều vấn đề khác nữa.

Đôi khi, chúng ta quên mất phải ngồi lại và mường tượng tất cả những chi tiết đó có nghĩa là gì. Thực tế hiện nay hầu hết những người làm SEO đều chưa từng được đào tạo, nên không có gì ngạc nhiên khi hầu hết họ đều không thực sự hiểu cách thức các công cụ tìm kiếm hoạt động như thế nào.

Lần gần đây nhất tôi suy nghĩ về cách thức hoạt động của Google là khi nào nhỉ? Có lẽ là vào tháng trước, đó là khi tôi đang viết bài về tính năng Hangout trên Google Webmaster và từ chối liên kết, ý nghĩ đó đã nảy ra trong đầu tôi.

Thật tình mà nói, tôi đã suy nghĩ về vấn đề này từ trước đây 8 – 10 năm. Vậy hãy cùng bàn luận về nó, hãy đứng trên góc độ cao hơn để giải thích cách thức Google hoạt động. Khi các thuật ngữ và trật tự các hoạt động có thể thay đổi đôi chút, Bing và Yahoo cũng sử dụng một giao thức tương tự.

Nội dung chính

Crawling và Indexing

Khi chúng ta nói Google đã “index” một website, nó có nghĩa là gì? Đối với những người làm SEO, nói một cách nôm na, nó có nghĩa là website đó đã xuất hiện trong kết quả tìm kiếm của Google (dưới dạng www.site.com), được thêm vào dữ liệu của Google, nhưng về mặt kỹ thuật thì trang web đó không nhất thiết phải được “crawl”, đó là lý do tại sao bạn có thể thấy điều này bất cứ lúc nào:

“Indexing” lại là một cái gì đó hoàn toàn khác biệt. Để đơn giản hóa, bạn hãy nghĩ theo cách này: các URL phải được Google khám phá ra trước khi được “crawl”, và chúng phải được “crawl” trước khi có thể được “index”, hay chính xác hơn, các URL có chứa những từ ngữ liên quan đến các từ ngữ đã được index trong Google.

Một người bạn mới của tôi, Enrico Altavilla, đã miêu tả vấn đề theo cách này. Dưới đây là nguyên bản những gì anh ấy đã nói:

Index không bao hàm những tài liệu, nó chỉ chứa đựng danh sách những từ, cụm từ mà tất cả các tài liệu có thể tham chiếu đều chứa các từ ngữ liên quan đến các từ, cụm từ này.

Chúng ta có thể nói “tài liệu đã được index” nhưng thực tế là “một số từ ngữ liên quan trong tài liệu đã giúp tài liệu đó được index”. Tài liệu trong định dạng thô được lưu trữ ở nơi khác.

Vanessa Fox, một người bạn cũ của tôi, từng làm việc cho Google đã nói về vấn đề này như sau:

Google nghiên cứu các URL … sau đó thêm các URL này vào trong hệ thống kế hoạch thu thập dữ liệu. Nó kiểm tra các từ ngữ trong danh sách để tránh trùng lặp, sau đó sắp xếp lại theo thứ tự ưu tiên và crawl trật tự đó.

Thứ tự ưu tiên sẽ được đánh giá dựa trên tất cả các yếu tố … Một khi trang web được crawl, Google sẽ chuyển sang quá trình thuật toán khác để xác định xem liệu trang web đó có được lưu trữ trong chỉ mục hay không.

Điều này có nghĩa là Google không crawl mọi trang web nó tìm hiểu và cũng không index mọi trang đã được crawl.

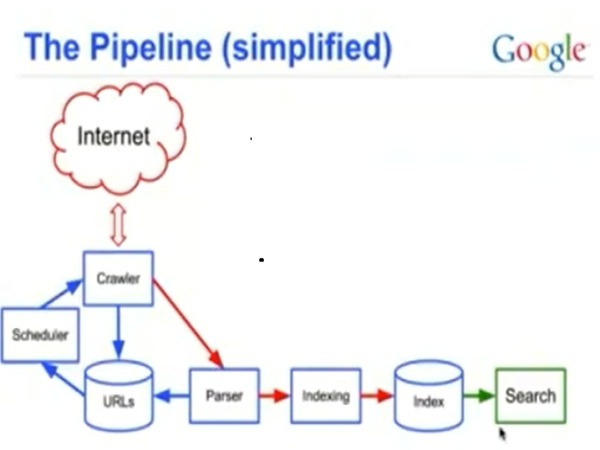

Dưới đây là mô hình đơn giản hóa được Google chia sẻ:

Hai vấn đề quan trọng khác cũng cần được lưu lý đó là:

• File robots.txt chỉ ngăn chặn crawl trang web. Đó là lý do tại sao đôi khi Google lại có những trang hiển thị trong kết quả tìm kiếm giống như ví dụ trên. Mặc dù Google có liên kết với trang này thông qua các từ ngữ liên quan trong các liên kết internal, nhưng nó lại không thể crawl nội dung của trang web đó.

• Các lệnh “noindex” trên cấp độ trang web không dứt khoát. Mặc dù Google có thể crawl trang web và index các từ liên quan trên trang đó, nhưng không có nghĩa là trang web đó sẽ được hiển thị trong kết quả tìm kiếm.

Tôi đã gặp trường hợp như này khi Google cho hiển thị một trang web “noindex” trong kết quả tìm kiếm dành cho người dùng, Google cho biết nó có thể không quan tâm đến các chỉ lệnh nếu có những dấu hiệu khác chỉ ra rằng trang web đó bao hàm đầy đủ yếu tố để được index. Đây chính là điểm khác biệt của Google so với các công cụ tìm kiếm, công cụ seo khác, trong khi Yahoo và Bing sẽ tôn trọng lệnh “noindex” này, chúng sẽ không index trang web trong kết quả tìm kiếm.

Một điều quan trọng khác cần lưu ý đó là sự hợp chuẩn, đi lệch thông số và một số các yếu tố khác trên trang web cũng được xử lý khi Google tìm hiểu trang và crawl hay index trang đó.

Liên kết và biểu đồ liên kết

Vấn đề tiếp theo mà các nhà làm SEO cần hiểu đó là về các liên kết và quá trình xử lý các liên kết. Quan trọng nhất ở đây là liên kết (gồm cả liên kết mở rộng, PageRank) không được xử lý khi quá trình crawl diễn ra. Nói cách khác, Google thực hiện crawl trang web nhưng PageRank không được xem xét trong quá trình đó, nó hoàn toàn tách biệt.

Điều này có nghĩa là gì?

• Dù nhiều người có nói gì đi nữa thì PageRank chính là một thông số đo lường chất lượng và số lượng các liên kết. Nó không có sự liên hệ nào với các từ các ngữ trên trang web.

• Nhiều người làm SEO tin rằng PageRank bao gồm 2 yếu tố: đó là cấp độ tên miền và cấp độ trang PageRank. Họ tin vào cấp độ tên miền, còn PageRank chỉ là một yếu tố xác định mức độ đáng tin của tên miền, đóng vai trò trong việc quyết định website được xếp hạng như nào. Tôi thì lại tin Google chắc chắn sẽ sử dụng nhiều yếu tố để xác định mức độ tin tưởng của tên miền, tuy nhiên Google chưa từng xác nhận điều này.

• Do PageRank được xử lý riêng biệt với quá trình crawl trang web nên lệnh dẫn hướng như “noindex,” “disallow – từ chối” và phong tỏa Referrer (thông tin được gửi từ trình duyệt người dùng) không ngăn chặn PageRank.

• Bạn không thể kiểm soát PageRank thông qua theo dõi Referrer. Nói cách khác, bạn không thể phong tỏa một Referrer định dạng .htaccess và mong đợi nó hoạt động trên Googlebot (bộ tìm kiếm của Google) dưới dạng một chỉ lệnh nofollow.

• Trái ngược với hầu hết những gì mọi người nghĩ, chuyển hướng 301 chuyển tác PageRank.

Chỉ tồn tại 4 yếu tố có thể ngăn chặn PageRank đó là:

1. Lệnh “nofollow” trên liên kết nguồn

2. Lệnh “disallow” trong file robots.txt trên trang nguồn của liên kết. Lệnh này hoạt động do file robots.txt ngăn công cụ tìm kiếm crawl nội dung trang nên ta không thể nhìn thấy đường link.

3. Lỗi 404 trên trang khởi nguồn

4. Lỗi 404 trên trang đích. Lý do duy nhất mà lỗi 404 trên cả trang nguồn và trang đích hoạt động đó là những lệnh này xảy ra trên server. Khi biểu đồ liên kết được xử lý, công cụ tìm kiếm không thể truy cập các trang này. Ngược lại, trang bị phong tỏa trong robots.txt có thể tiếp tục ảnh hưởng đến PageRank do nó có tồn tại, nó chỉ không được thêm chỉ mục mà thôi.

Ảnh chụp màn hình slide trong Webmaster Hangout được Google chia sẻ vào ngày 20/8/2012 sẽ miêu tả vấn đề này:

Cách duy nhất để giải quyết các liên kết xấu đó là từ chối nguồn liên kết. Việc này có tác động kỹ thuật tương tự như khi ta thêm lệnh “nofollow” vào liên kết nguồn nếu được Google chấp thuận.

Và đó là cách Google hoạt động

Hy vọng rằng, bạn đã nắm được rõ ràng phương thức hoạt động của Google. Những yếu tố chủ chốt cần nhớ đó là:

1. Crawling không giống indexing.

2. PageRank tách biệt với quá trình crawling.

3. Chỉ có 4 cách để phong tỏa PageRank, và thêm một lựa chọn bổ sung là từ chối liên kết.